Non, il ne s’agit pas du logo d’une nouvelle marque d’aliments pour chien ! Hey, on est sur un blog qui parle techno ou pas ? Rappelez-vous, nous avons parlé il y a quelques temps de DeepMind qui est devenu le champion international de Go grâce au Deep Learning (Tensorflow). Aujourd’hui, nous allons parler de Deep… Voice ! Rien à voir avec Google, mais plutôt avec les chinois de Baidu ! Chez Google, la technologie Tensorflow est présente à tous les étages et a permis de d’améliorer grandement des services comme Google Translate (vous verrez, bientôt, les traductions seront parfaites: elles le sont en anglais-chinois déjà). Des technologies comme la reconnaissance ou la synthèse vocale dérivent un peu de tout ça. Qu’en est-il chez Baidu ? Déjà qu’ils ont 80% du traffic coté moteur de recherche en chine… veulent-ils investir d’autres domaines avec force et rage ?

Baidu a ouvert en 2013 un laboratoire de recherche en intelligence artificielle (IA) dans la Silicon Valley. Il s’est lancé dans un travail sur la synthèse de la parole.

Les systèmes Text-to-speech (synthèse vocale comme le Dr Sbaitso ! pour les plus vieux) sont familiers dans le monde moderne dans les applis de navigation, horloges parlantes, répondeurs téléphonique. Je me rappelle encore de ce petit boiter que je branchais derrière mon CPC 464 et qui épataient mes amis en faisant parler le bouzin ! C’était l’époque « Les petits génies » (The Whiz kids) et Joshua de Wargames !

Désolé, j’ai pas pu m’empêche, c’était la séquence nostalgie 😉

La synthèse vocale ancienne génération passait par l’enregistrement d’une grande base de données de vocables d’une seule personne, éléments ensuite recombinés pour faire de nouvelles phrases. Un peu comme dans le film « les experts » (Sneakers) avec cette phrase devenue célèbre « ma voix est mon passeport, contrôlez moi« …

Le problème, avec ces systèmes, est qu’il est difficile de réaliser des modifications sur la voix sans enregistrer une base de données entièrement nouvelle. le travail a donc porté sur une autre approche, synthétiser la parole en temps réel à partir de zéro !

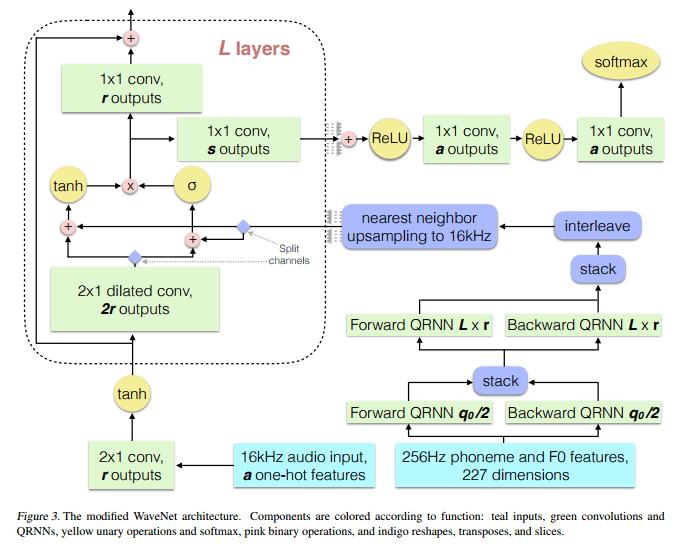

L’année dernière, DeepMind de Google a fait une percée importante dans ce domaine. Il a dévoilé un réseau de neurones qui apprend à parler en écoutant les ondes sonores de la parole et en la comparant à un document écrit du même texte. Après la formation, il a été en mesure de produire la parole synthétique à base de nouveau texte. Google DeepMind a appelé son système WaveNet.

La principale difficulté de la synthèse vocale est la diminution du temps de retraitement par des experts humains. Pour y faire face, Baidu a surmonté le problème et obtenu une vitesse de calcul 400 fois plus rapide que WaveNet (à matériel équivalent). Donc, moins de besoins de ce coté là.

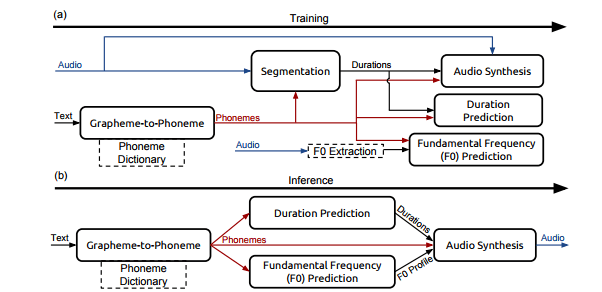

Le système comprend cinq blocs de construction majeurs, avec réseau neural pour chaque:

- un modèle de segmentation pour localiser les limites de phonèmes (réseaux neuronaux profonds utilisant une perte de classification temporelle connexionniste (CTC)),

- un modèle de conversion de grapheme-to-phonème,

- un modèle de prédiction de durée de phonème (pour le rythme je suppose)

- un modèle de prédiction de fréquence fondamentale (pour les intonations je suppose)

- et un modèle de synthèse audio (variante de Wavenet, plus rapide).

Par exemple, pour dire hello, nous avons: « (silence HH), (HH, EH), (EH, L), (L, OW), (OW, silence) », chaque phonème sera pris dans le système de synthèse vocale.

Ainsi, son système de synthèse vocale de qualité est entièrement construit à partir des réseaux de neurones profonds. Il n’y a pas de retraitement humain derrière !

Deep Voice apprend ainsi à parler de façon fluide en quelques heures avec peu ou pas d’interférence humaine.

« Pour effectuer le travail en temps réel, nous devons prendre grand soin de ne jamais recalculer aucun résultat, stocker l’ensemble du modèle dans le cache du processeur et d’utiliser de façon optimale les unités de calcul disponibles », disent les chercheurs Baidu.

Écoutez quelques exemples ici.

0 commentaires