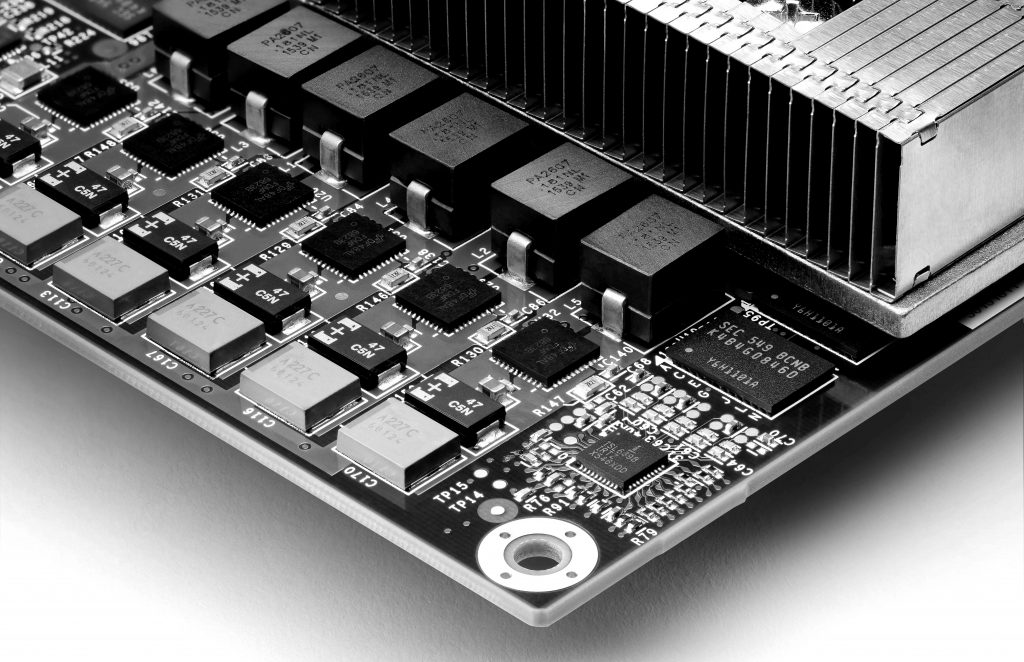

Google avait déjà commencé à construire de nombreux éléments pour ses centres de données. Il conçoit maintenant ses propres processeurs. Tensor ou plutôt Tensor Processing Unit (TPU) est une puce construite spécialement pour l’apprentissage. Google n’a pas de besoin de haute précision pour l’intelligence artificielle, le processeur Tensor est axé sur les opérations brutes par seconde, c’est à dire des taches spécifiques. Il est plus rapide pour l’IA que les processeurs habituels à des niveaux d’énergie similaires. Il est conçu aussi de petite taille pour pouvoir être inclus dans les baies de disques durs dans les racks des centres de données. Cette puce ne remplacera pas les processeurs habituels, mais par oppositions aux autres processeurs spécialisés dans l’apprentissage machine, elle est plus économique en énergie.

Ce processeur a été utilisé pour une compétition de Go l’an dernier qui a montré la victoire de AlphaGo sur le champion humain de Go.

L’apprentissage machine se généralise de la reconnaissance vocale à la traduction et l’analyse de données, ces tâches nécessitent des accélérations spécifiques. La TPU est déjà utilisée en production sur le cloud de Google. Elle alimente aussi le système de tri de résultats RankBrain, la Google Map et les services de reconnaissance vocale de Google.

Malheureusement, Google ne compte pas vendre ses TPU, que vous soyez un professionnel ou non. La firme compte les utiliser pour améliorer tous ses services nécessitant de l’intelligence artificielle.

En fait, ils ne peuvent pas les vendre – Vous savez pourquoi ? regardez la photo précédente ! Les lanières, c’est pour attacher la tête de leurs salariés – en fait le TPU suce le cerveau des collaborateurs de google – ceux avec le T-Shirt Google Brain – Comme des citrons, on presse, et des neurones tombent dans le TPU, pis après on évacue le reste du collaborateur… Bon, je déconne, c’est pour sortir les blocs de cartes mères, les changer au besoin… 🙂 Mais si ce n’est pas littéral, c’est quand même en partie vrai sur un plan symbolique.

Vous pouvez toutefois utiliser TensorFlow, bibliothèque de logiciels open source de calcul numérique qui utilise des graphiques de flux de données. Les nœuds du graphique représentent des opérations mathématiques, les bords du graphique représentent les tableaux de données multidimensionnelles. TensorFlow a été initialement développé pour l’apprentissage machine et la recherche sur les réseaux de neurones.

Y-a encore beaucoup à dire sur TensorFlow, mais il faut que je teste un peu de mon coté avant de vous en reparler. Si vous êtes pressés, allez voir sur le site officiel.

0 commentaires