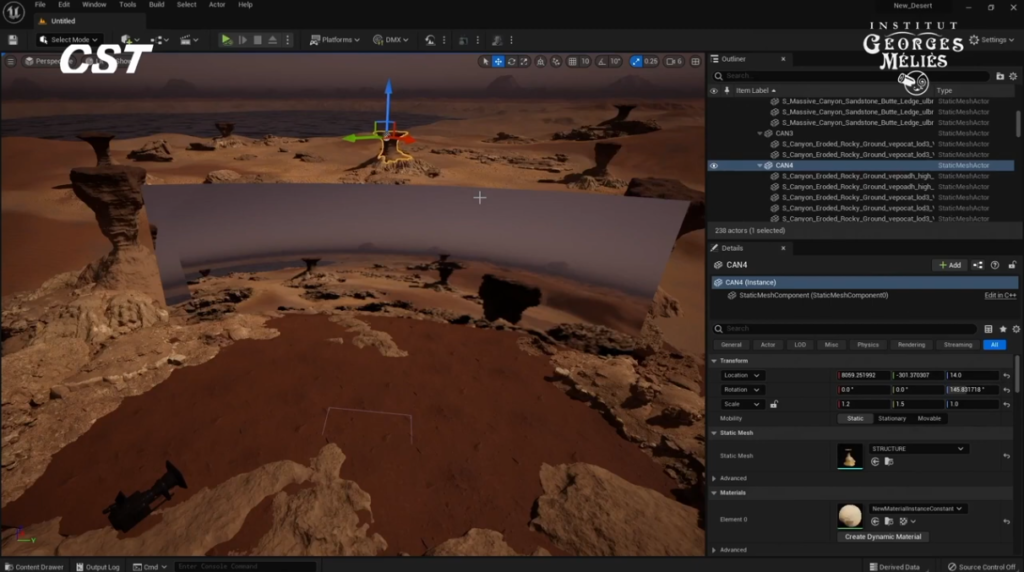

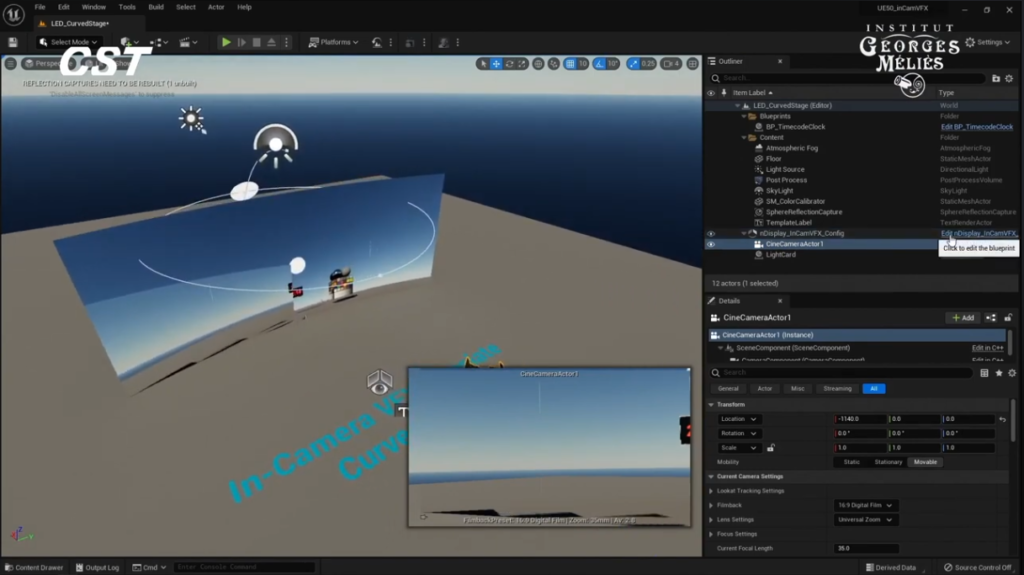

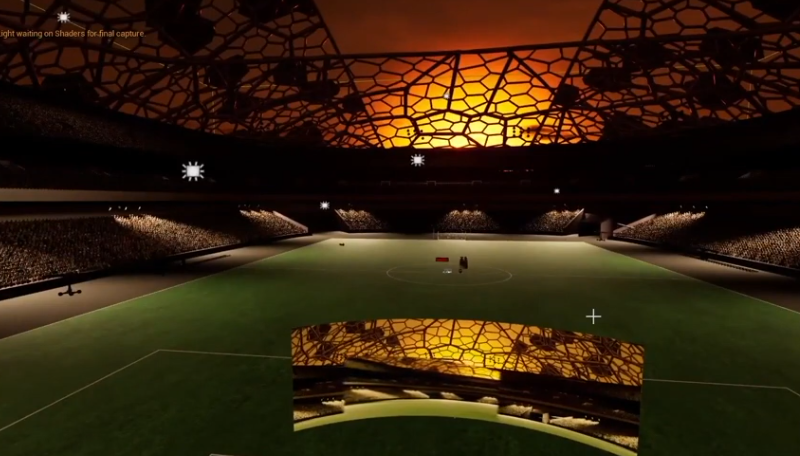

Dans cette conférence, les intervenants nous montrent comme paramétrer un panneau virtuel à base de LED dans Unreal Engine et comment l’utiliser en temps-réel pour se passer d’un écran vert et réaliser des effets spéciaux en temps-réel.

Sommaire

Les plateaux virtuels sous Unreal Engine

Le principe est ici d’utiliser un modèle LED sur la scène (c’est une cam en réalité) comme on a sur le plateau pour positionner les autres éléments (plugin nDisplay). Le système de tracking utilisé est MotiveEdit 2.3.0 d’optitrack. Les panneaux mobiles sont eux-aussi traqués. Avoir un fond fixe qui correspond à la réalité physique et une caméra qui correspond à la perspective correspondant à l’univers 3D pour respecter les réflexions. Tous les éléments 3D ajoutés doivent correspondre à l’échelle humaine. Inconvénient : doit caler le sol 3D avec le sol réel pour éviter un effet de découpe. Avantage : comme on est en 3D, tout objet placé devant l’écran LED est comme s’il était en avant-plan sur le compositing. Il y a 3 plans exploitables en réalité (fond LED, plateau et objets 3D en avant plan). On apprend que pour la gestion des foules, ils n’ont pas travaillé avec Golaem. Optitrack, c’est surtout au départ pour la Mocap. On peut combiner trackers et combinaisons, multiplier le nombre de capteurs, etc. Il a bien sûr ses limites, mais on passe très vite d’une cam à l’autre (steadycam par exemple) en ajoutant un tracker. Tout est genlocké (synchronisation du temps pour synchro des cams et d’UE5).

Intervenants : Bruno CORSINI et François SIMEREY / PolygonSoup

François SIMEREY, Fondateur, POLYGON SOUP

Après des années de création graphique dans divers domaines (imprimerie, CG d’architecture, événementiel) puis de scénographie événementielle, je découvre le mapping vidéo avec Martin Arnaud (Les Petits Français) et Christophe Bertiaux (Mon oeil de Bertiaux) pour la réalisation d’un spectacle multimédia à Madrid, “Bollywoodland, Love never dies” (2009).

En même temps, j’ai commencé à utiliser Houdini FX, un étonnant logiciel de VFX 3D de SideFX. Aujourd’hui, je suis un utilisateur féru de Houdini utilisant la modélisation procédurale, les simulations de fluide, d’océan, de feu, de destruction, VEX/VOP, les shaders, python et les outils personnels développés pour le mapping vidéo.

Depuis, je développe constamment des créations graphiques pour des spectacles multimédia, avec deux prix THEA à la clé, et j’interviens au sein de la société Plateau Virtuel en tant qu’opérateur Unreal Engine , développeur R&D , et superviseur VFX pour Polygon Soup sur les tournage en plateau Virtuel.

Bruno CORSINI, Chef de projet, POLYGON SOUP

Après une formation de scénographe dans une école du spectacle vivant, Bruno CORSINI a éclairé plusieurs artistes (Les Rita Misouko, IAM ,Yael Naim, IBEYI…) et participé à de nombreux évènements nationaux et internationaux (Bicentenaire indépendance du Chili, Centenaire de la révolution du Mexique, Spectacles Nocturnes Disney Tokyo…) .

La vidéo a toujours été un élément majeur dans toutes ses scénographies et c’est naturellement qu’il s’est associé avec un directeur Photo pour créer lors de la pandémie le Plateau Virtuel.

0 commentaires